6 สิงหาคม 2567

การเปิดตัว Advanced Voice Mode ของ OpenAI

- เปิดตัวโหมดเสียงใหม่ : OpenAI เปิดตัว Advanced Voice Mode สำหรับผู้ใช้ ChatGPT Plus กลุ่มเล็กๆ โดยจะขยายให้ผู้ใช้ทั่วไปได้ใช้ในฤดูใบไม้ร่วงนี้ ช่วยให้สนทนากับ AI ผ่านเสียงได้อย่างเป็นธรรมชาติมากขึ้น

- ปัญหาด้านเสียง :การเปิดตัวล่าช้ากว่ากำหนดเดิม หลังมีข้อพิพาทกับนักแสดงฮอลลีวูดที่กล่าวหาว่า OpenAI พยายามเลียนแบบเสียงของเธอ ทำให้ต้องถอดเสียง AI ออกไปก่อน

- ความปลอดภัยและคุณภาพ : OpenAI เน้นย้ำความพยายามในการสร้างความปลอดภัยและคุณภาพของ Advanced Voice Mode ผ่านการทดสอบอย่างละเอียด เพื่อสร้างความมั่นใจให้ผู้ใช้และหน่วยงานกำกับดูแล

- ยกระดับ AI : การเพิ่ม Advanced Voice Mode ใน ChatGPT ถือเป็นการยกระดับ conversational AI ให้ดียิ่งขึ้น และตอกย้ำความเป็นผู้นำของ OpenAI ในตลาด AI ที่การแข่งขันกำลังดุเดือด

รายละเอียดการเปิดตัว Advanced Voice Mode

ประกาศเปิดตัว Alpha OpenAI ได้ประกาศการเปิดตัว Alpha ของ Advanced Voice Mode ใหม่สำหรับผู้ใช้ ChatGPT Plus กลุ่มเล็กๆ ซึ่งช่วยให้พวกเขาสามารถพูดคุยกับ AI chatbot ได้อย่างเป็นธรรมชาติมากขึ้นบนแอป ChatGPT อย่างเป็นทางการสำหรับ iOS และ Android

การทดสอบเบื้องต้น บน X บริษัทได้โพสต์จากบัญชีของตนว่าโหมดนี้จะพร้อมใช้งานสำหรับ “ผู้ใช้ ChatGPT Plus กลุ่มเล็กๆ” แม้ว่าบริษัทจะเสริมในโพสต์ติดตามว่า “เราจะเพิ่มผู้คนเข้ามาเรื่อยๆ และวางแผนให้ทุกคนใน [ChatGPT] Plus สามารถเข้าถึงได้ในฤดูใบไม้ร่วง“

บริการสมัครสมาชิก ChatGPT Plus เป็นบริการสมัครสมาชิกรายบุคคลมูลค่า $20 ต่อเดือนที่ OpenAI เสนอให้เข้าถึง chatbot ที่ขับเคลื่อนด้วย Large Language Model (LLM) พร้อมกับระดับอื่นๆ เช่น Free, Team, Enterprise

กลุ่มผู้ใช้เริ่มต้น ยังไม่ชัดเจนว่า OpenAI เลือกกลุ่มผู้ใช้เริ่มต้นให้เข้าถึง Advanced Voice Mode อย่างไร แต่บริษัทโพสต์ว่า “ผู้ใช้ใน alpha นี้จะได้รับอีเมลพร้อมคำแนะนำและข้อความในแอปมือถือ” สำหรับ ChatGPT ดังนั้นผู้ที่สนใจควรตรวจสอบที่นั่น

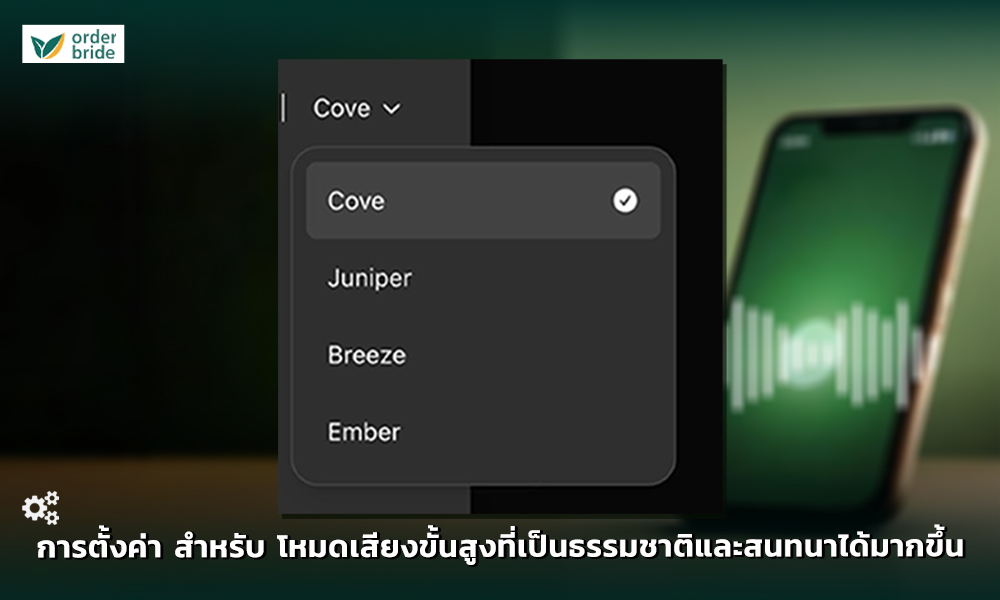

คุณสมบัติและการใช้งาน คุณสมบัตินี้ซึ่งแสดงในงาน Spring Update ของ OpenAI เมื่อเดือนพฤษภาคม 2024 ช่วยให้ผู้ใช้สามารถมีส่วนร่วมในการสนทนาแบบเรียลไทม์กับเสียง AI สี่เสียงบน ChatGPT และ chatbot จะพยายามสนทนากลับอย่างเป็นธรรมชาติ รับมือกับการขัดจังหวะ และตรวจจับ ตอบสนอง และสื่ออารมณ์ที่แตกต่างกันในคำพูดและน้ำเสียง

กรณีการใช้งานที่เป็นไปได้ OpenAI แสดงกรณีการใช้งานที่เป็นไปได้หลายอย่างสำหรับ Advanced Voice Mode ที่เป็นธรรมชาติและเป็นกันเองมากขึ้น รวมถึง เมื่อรวมกับความสามารถด้าน Vision ในการดูและตอบสนองต่อวิดีโอสด ทำหน้าที่เป็นผู้ช่วยสอน ที่ปรึกษาด้านแฟชั่น และคู่มือสำหรับผู้พิการทางสายตา

ความล่าช้าและข้อพิพาท

ข้อขัดแย้งกับนักแสดงฮอลลีวูด การเปิดตัวคุณลักษณะนี้ล่าช้ากว่าที่ OpenAI ประมาณการเดิมในปลายเดือนมิถุนายน หลังจากเกิดข้อขัดแย้งที่นักแสดงและคนดังฮอลลีวูด Scarlett Johansson (Black Widow ของ Marvel และเสียงของ AI ในเรื่อง Her) กล่าวหาว่า OpenAI พยายามทำงานกับเธอและเลียนแบบเสียงของเธอแม้หลังจากที่เธอปฏิเสธ

การปฏิเสธและการถอดเสียง OpenAI ปฏิเสธว่าความคล้ายคลึงใดๆ ระหว่างเสียง AI “Sky” ของตนและเสียงของ Johansson ใน Her นั้นเป็นไปโดยเจตนา แต่ถอดเสียงออกจากไลบรารีและยังคงออฟไลน์จนถึงทุกวันนี้

การยอมรับความล่าช้า บน X วันนี้ บัญชี ChatGPT App อย่างเป็นทางการยอมรับความล่าช้า โดยเขียนว่า “Advanced Voice Mode ที่รอคอยมานาน กำลัง เริ่มเปิดตัว!”

ความตื่นเต้นเกี่ยวกับคุณสมบัติใหม่ Mira Murati หัวหน้าเจ้าหน้าที่ฝ่ายเทคโนโลยีของ OpenAI แสดงความกระตือรือร้นเกี่ยวกับคุณสมบัติใหม่ในโพสต์บน X “การสนทนาแบบเรียลไทม์ที่สมบูรณ์และเป็นธรรมชาติมากขึ้นทำให้เทคโนโลยีมีความยืดหยุ่นน้อยลง เราพบว่ามันมีความร่วมมือและเป็นประโยชน์มากขึ้น และคิดว่าคุณก็จะเช่นกัน

ความปลอดภัยและการควบคุม

การทดสอบและการปรับปรุงคุณภาพ หลังจากข้อผูกมัดและเอกสารด้านความปลอดภัยใหม่จำนวนมาก การประกาศอย่างเป็นทางการของ OpenAI เน้นย้ำถึงความพยายามอย่างต่อเนื่องเพื่อให้แน่ใจถึงคุณภาพและความปลอดภัย

การเสริมความปลอดภัย “ตั้งแต่ที่เราสาธิตโหมด Advanced Voice ครั้งแรก เราได้ทำงานเพื่อเสริมความปลอดภัยและคุณภาพของการสนทนาด้วยเสียงขณะที่เราเตรียมนำเทคโนโลยีแนวหน้านี้มาสู่ผู้คนนับล้าน” บริษัทกล่าวใน X โดยเสริมว่า “เราทดสอบความสามารถด้านเสียงของ GPT-4o กับทีมสีแดงภายนอกมากกว่า 100 ทีมใน 45 ภาษา เพื่อปกป้องความเป็นส่วนตัวของผู้คน เราได้ฝึกฝนโมเดลให้พูดในเสียงที่ตั้งไว้ล่วงหน้าสี่เสียงเท่านั้น และเราสร้างระบบเพื่อบล็อกเอาต์พุตที่แตกต่างจากเสียงเหล่านั้น นอกจากนี้เรายังได้ใช้การ์ดเรลเพื่อบล็อกคำขอเนื้อหาที่รุนแรงหรือมีลิขสิทธิ์“

การใช้ AI ในทางที่ผิด ข่าวนี้มาในขณะที่ความสามารถของ AI ในการใช้เป็นเครื่องมือสำหรับการฉ้อโกงหรือการแอบอ้างกำลังได้รับการตรวจสอบใหม่อีกครั้ง

การควบคุมเสียงที่สร้างโดย AI แม้ว่า Voice Mode ของ OpenAI จะไม่อนุญาตให้มีเสียงที่สร้างโดย AI ใหม่หรือการโคลนเสียงในปัจจุบัน แต่โหมดนี้อาจถูกใช้เพื่อหลอกผู้อื่นที่ไม่รู้ว่าเป็น AI

กรณีของ Elon Musk ในทางกลับกัน Elon Musk อดีตผู้สนับสนุน OpenAI และผู้ร่วมก่อตั้งคู่แข่ง ถูกวิพากษ์วิจารณ์ในสัปดาห์นี้สำหรับการแชร์การโคลนเสียงของผู้สมัครชิงตำแหน่งประธานาธิบดีพรรคเดโมแครต Kamala Harris ในวิดีโอที่โจมตีเธอ

สรุป

การให้ความสำคัญกับความปลอดภัย ในช่วงเดือนที่ผ่านมาหลังจากงาน Spring Update OpenAI ได้เผยแพร่เอกสารใหม่จำนวนมากเกี่ยวกับความปลอดภัยและเทคนิคการปรับแนว AI model (การปฏิบัติตามกฎและวัตถุประสงค์ของมนุษย์) การเผยแพร่ยังเกิดขึ้นหลังจากการยุบทีม superalignment และการวิพากษ์วิจารณ์จากพนักงานบางคนในอดีตและปัจจุบันว่าบริษัทเบี่ยงเบนความสนใจในเรื่องความปลอดภัยเพื่อเปิดตัวผลิตภัณฑ์ใหม่

การเปิดตัวอย่างระมัดระวัง เป็นที่ชัดเจนว่า การเปิดตัว Advanced Voice Mode อย่างช้าๆ ดูเหมือนได้รับการออกแบบมาเพื่อโต้แย้งข้อวิจารณ์เหล่านั้น และปลอบใจผู้ใช้และอาจเป็นหน่วยงานกำกับดูแลหรือนักกฎหมายว่า OpenAI ให้ความสำคัญกับความปลอดภัยอย่างจริงจังและให้ความสำคัญเท่ากับหรือมากกว่าผลกำไร

แหล่งที่มา : https://www.prompt-expert.co/news/openai-launches-chatgpt-advanced-voice-mode-mobile/